مع توسّع دور أنظمة الذكاء الاصطناعي في اتخاذ قرارات مستقلة داخل قطاعات حيوية، لم يعد السؤال يقتصر على كفاءة هذه الأنظمة؛ بل أصبح يشمل مدى عدالتها أيضاً. وفي هذا السياق، قدّم باحثون من معهد ماساتشوستس للتكنولوجيا (MIT) منهجية جديدة تهدف إلى رصد مخاطر العدالة في أنظمة اتخاذ القرار المستقلة قبل نشرها، ما قد يشكّل تحولاً في طريقة تقييم هذه التقنيات.

وعادةً ما تُصمَّم الأنظمة المستقلة لتحسين نتائج قابلة للقياس؛ ففي شبكات الطاقة، على سبيل المثال، قد يحدد نموذج ذكاء اصطناعي كيفية توزيع الكهرباء بطريقة تقلل التكاليف وتحافظ على الاستقرار. لكن هذا النوع من التحسين لا يأخذ بالضرورة في الاعتبار كيفية توزيع النتائج بين مختلف الفئات المجتمعية؛ فقد تبدو الاستراتيجية فعّالة من الناحية التقنية، لكنها قد تؤدي إلى تحميل أحياء ذات دخل منخفض عبء انقطاعات الكهرباء، مقابل حماية مناطق أكثر ثراءً.

«الصناديق سوداء»

هذا التوتر بين الكفاءة والعدالة يشكّل جوهر البحث الجديد؛ فقد طوّر فريق «MIT» منهجية تقيم بشكل منهجي كيف توازن الأنظمة المستقلة بين هذه الأولويات المتنافسة. وبدلاً من التركيز فقط على مؤشرات الأداء التقنية، يدمج النهج الجديد عوامل كمية مثل التكلفة وموثوقية النظام مع اعتبارات نوعية تشمل العدالة والإنصاف.

تقنياً، تعمل هذه المنهجية بوضفها إطار تقييم آلياً، حيث تحلل القرارات التي تتخذها أنظمة الذكاء الاصطناعي وتحدد الحالات التي قد تؤدي إلى نتائج إشكالية أخلاقياً. ومن خلال رصد هذه المخاطر في مرحلة مبكرة، تتيح الأداة للمطورين وصناع القرار وأصحاب المصلحة تقييم المفاضلات قبل تطبيق الأنظمة في الواقع.

وتكتسب هذه القدرة أهمية خاصة لأن العدالة في الذكاء الاصطناعي ليست دائماً واضحة؛ فكثير من الخوارزميات تعمل بوصفها «صناديق سوداء»، ما يجعل من الصعب تتبع كيفية اتخاذ القرارات أو تفسير النتائج. وفي كثير من الأحيان، لا يكون التحيّز مقصوداً؛ بل ينشأ من البيانات المستخدمة في تدريب النظام أو من طريقة تصميم أهدافه.

وتعالج المنهجية الجديدة هذا التحدي من خلال توفير طريقة منظمة لتقييم العدالة جنباً إلى جنب مع مؤشرات الأداء التقليدية. وبدلاً من التعامل مع العدالة عاملاً ثانوياً أو متطلباً تنظيمياً منفصلاً، تصبح جزءاً أساسياً من عملية تصميم واختبار الأنظمة.

تداعيات الذكاء المستقل

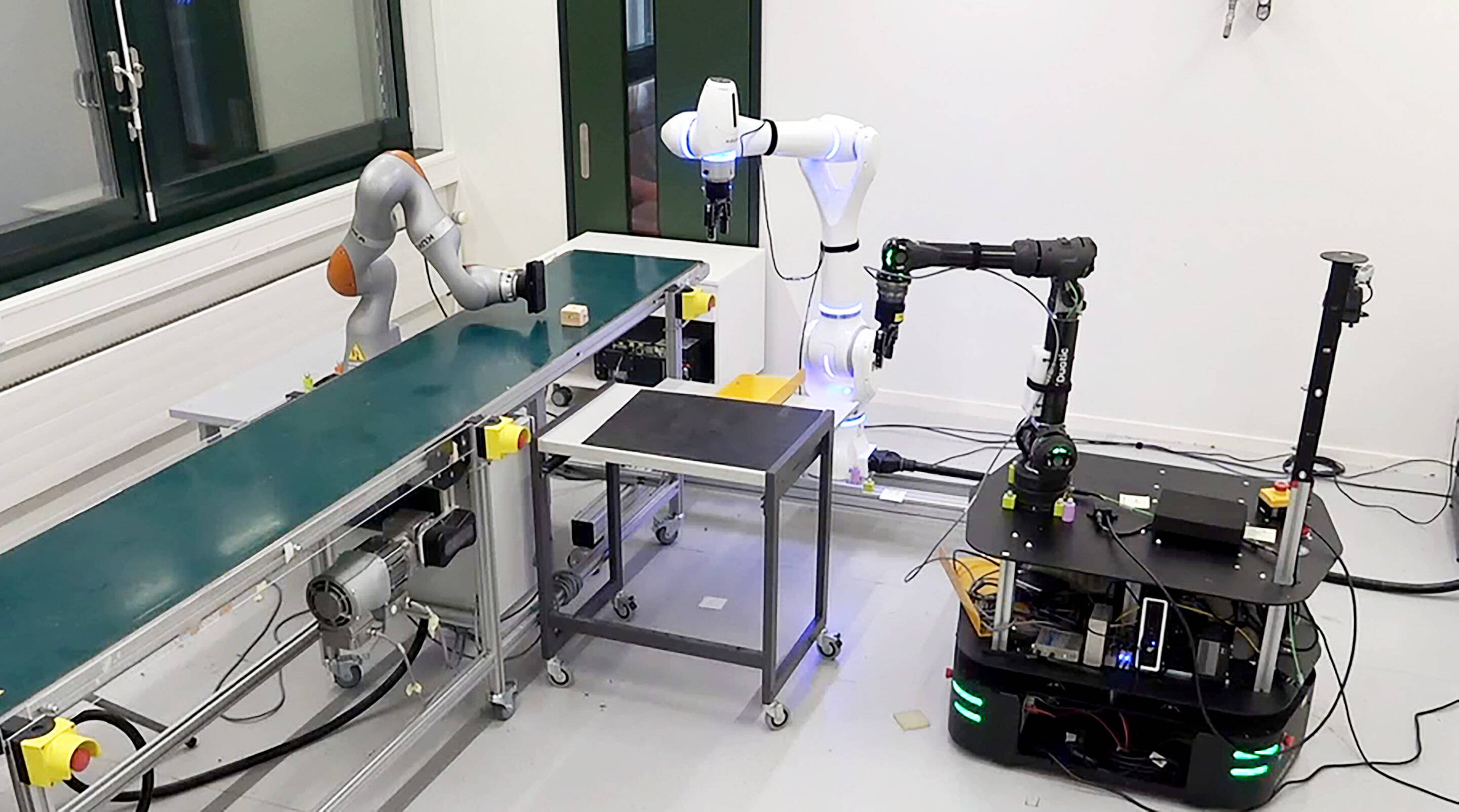

لا تقتصر تداعيات هذا النهج على قطاع الطاقة؛ فأنظمة اتخاذ القرار المستقلة تُستخدم بشكل متزايد في مجالات مثل التخطيط الحضري، وتوزيع الموارد الصحية، والمركبات ذاتية القيادة. وفي كل من هذه المجالات، يمكن أن يكون لقرارات الذكاء الاصطناعي تأثيرات اجتماعية واسعة، خصوصاً عندما تتعلق بالوصول إلى خدمات أساسية.

وفي قطاع النقل، على سبيل المثال، قد تعمل خوارزميات التوجيه على تقليل زمن الرحلات، لكنها قد تفضّل مناطق معينة على حساب أخرى. وفي الرعاية الصحية، قد تسعى نماذج توزيع الموارد إلى تحقيق الكفاءة، لكنها قد لا تضمن توزيعاً عادلاً بين مختلف الفئات السكانية. ومن خلال توفير وسيلة منهجية لرصد هذه المخاطر، يُسهم بحث «MIT» في تعزيز تطوير أنظمة ذكاء اصطناعي أكثر مسؤولية ومواءمة مع القيم الاجتماعية.

كما يعكس هذا العمل توجهاً متزايداً نحو ما يُعرف بـ«الذكاء الاصطناعي الموثوق»، وهو إطار يركز على الشفافية والمساءلة والعدالة إلى جانب الأداء. ومع ذلك، فإن مفهوم العدالة في هذا السياق ليس موحداً؛ إذ قد يشير إلى المساواة في النتائج، أو في المعاملة، أو في توزيع الموارد، بحسب التطبيق. وهذا التعقيد يجعل من الصعب تصميم أنظمة تحقق الكفاءة والإنصاف في الوقت ذاته.

ولا تسعى منهجية «MIT» إلى حسم هذه النقاشات الفلسفية؛ بل تقدم أداة عملية تكشف نقاط التوازن والمفاضلة بين هذه الأهداف. ومن خلال إظهار هذه المفاضلات بشكل واضح، تتيح لصنّاع القرار التعامل معها بوعي، بدلاً من بقائها مخفية داخل العمليات الخوارزمية.

ومن أبرز مساهمات هذا البحث تركيزه على التقييم قبل النشر؛ فكثير من الجهود الحالية في مجال عدالة الذكاء الاصطناعي يركز على اكتشاف التحيّز بعد تطبيق الأنظمة، وهو نهج تفاعلي قد يكون مكلفاً وصعب التنفيذ، خصوصاً عندما تكون الأنظمة قد أصبحت جزءاً من بنى تحتية حيوية.

تقييم قبل النشر

في المقابل، يتيح النهج الجديد استراتيجية استباقية، حيث يمكن للمطورين اختبار سيناريوهات متعددة، وتقييم التأثيرات المحتملة، وضبط معايير النظام قبل إطلاقه. وهذا لا يقلل فقط من مخاطر الأضرار غير المقصودة؛ بل يتماشى أيضاً مع التوجهات التنظيمية المتزايدة التي تركز على تقييم المخاطر والمساءلة في أنظمة الذكاء الاصطناعي.

ومع ذلك، يسلّط هذا النهج الضوء أيضاً على التحديات المستمرة في تحويل مفهوم العدالة إلى تطبيق عملي داخل أنظمة معقدة؛ فالأنظمة المستقلة غالباً ما تتكون من عناصر متعددة تتفاعل ضمن بيئات ديناميكية، ما يجعل ضمان العدالة بشكل مستمر أمراً صعباً، خصوصاً مع توسّع نطاق استخدامها.

إضافة إلى ذلك، قد تتعارض اعتبارات العدالة أحياناً مع أهداف أخرى مثل تقليل التكاليف أو تحسين الكفاءة. والتعامل مع هذه التعارضات يتطلب ليس فقط حلولاً تقنية؛ بل أيضاً قرارات سياسية ومشاركة مجتمعية.

وفي هذا الإطار، لا تهدف الأدوات مثل تلك التي طوّرها فريق «MIT» إلى استبدال الحكم البشري؛ بل إلى دعمه وتزويده بمعلومات أوضح. ومع استمرار توسّع دور الأنظمة المستقلة في المجتمع، تصبح القدرة على تقييم آثارها الأوسع أمراً ضرورياً.

ويمثّل هذا البحث خطوة نحو تقييم أكثر شفافية ومنهجية لهذه الأنظمة، من خلال توفير وسيلة لرصد المخاطر الأخلاقية قبل أن تتحول إلى واقع. وهو ما يعكس تحوّلاً أوسع في مسار الذكاء الاصطناعي: من التركيز على ما يمكن أن تفعله الأنظمة، إلى التساؤل عن كيفية أدائها، ولصالح مَنْ.